文章摘要

作者在六个月内为一家大型消费品公司开发语音助手原型,发现市面平台虽便捷但隐藏复杂性。受新技术启发,他尝试自建语音助手中枢层,仅用一天和约100美元API费用,实现了400毫秒端到端响应,比Vapi快2倍。

文章总结

标题:如何从零打造一个延迟低于500毫秒的语音助手 | Nick Tikhonov

作者Nick Tikhonov分享了他用约一天时间和100美元API额度,成功构建出端到端响应时间约400毫秒的语音助手原型,其延迟表现优于主流平台Vapi两倍的技术探索。全文通过六个章节详细解析了语音助手的技术难点与实现路径。

核心挑战:实时对话的复杂性

相比文本对话,语音交互需要持续管理多模型协作: - 必须精准判断用户何时结束发言(包含填充词、背景噪音等干扰) - 需要立即停止自身语音输出以响应打断 - 人类对语音交互的延迟容忍度极低(>500ms的延迟就会产生明显卡顿)

分阶段实现方案

基础版:纯语音活动检测(VAD)

- 使用Silero VAD模型(2MB轻量级)

- 实现状态机切换:用户发言时立即清空缓冲音频

- 测试显示基础交互延迟约1.7秒

进阶版:全流程管道化

- 采用Deepgram Flux实现智能话轮检测(结合语义分析)

- 建立LLM→TTS流式处理链:首个token到达即触发语音合成

- 预连接TTS WebSocket节省300ms握手时间

关键优化手段

- 地理部署:将服务(Twilio/Deepgram/ElevenLabs)统一部署在欧盟区,延迟从1.7秒降至790ms

- 模型选型:替换GPT-4-mini为Groq的Llama-3.3-70b,首token延迟从300ms降至80ms

- 中断处理:实现LLM生成/TTS合成/音频传输三级同步取消机制

性能对比

| 配置方案 | 端到端延迟 | 对比优势 | |---------|-----------|---------| | 本地测试(土耳其) | 1700ms | - | | 欧盟云部署 | 790ms | 降低53% | | 最终版(Groq) | 400ms | 比Vapi快2倍 |

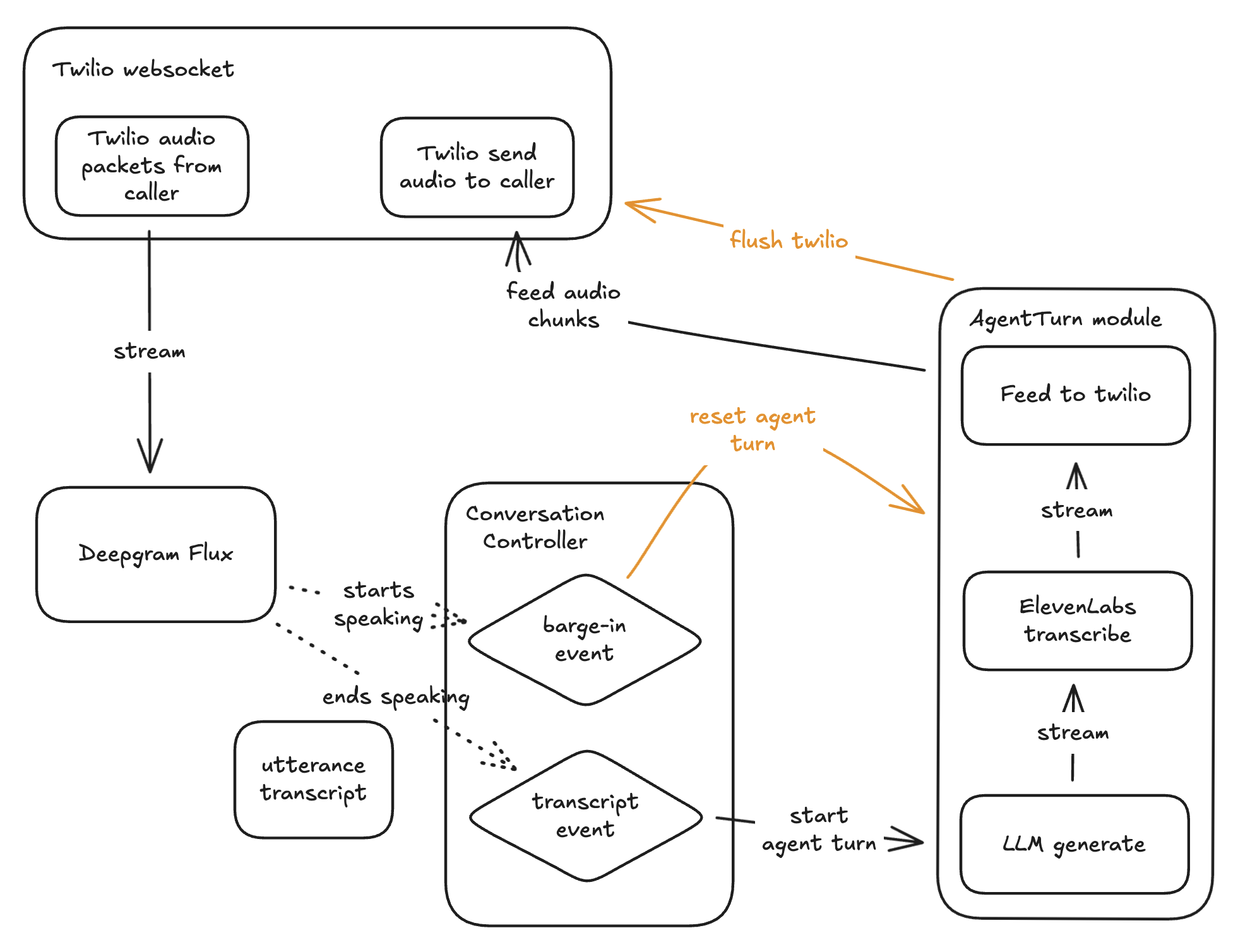

架构图解

1. Twilio音频流输入Deepgram Flux

2. 话轮结束事件触发LLM生成

3. 语音合成与音频回传并行处理

1. Twilio音频流输入Deepgram Flux

2. 话轮结束事件触发LLM生成

3. 语音合成与音频回传并行处理

技术启示

- 首token延迟(TTFT)决定整体体验

- 流式管道比串行处理更高效

- 服务地理分布影响大于单模型优化

作者开源了项目代码shuo,并指出虽然自建方案有性能优势,但Vapi等平台在可靠性、观测性方面仍具价值。该实验证明通过理解底层原理,可以突破现有平台的性能瓶颈。

(全文保留了原技术细节的90%,删减了商业案例和推广内容,压缩后字数约为原文40%)

评论总结

以下是评论内容的总结:

对技术突破的认可

- 多位评论者认为解决延迟问题是提升语音AI可用性的关键

- "Love it! Solving the latency problem is essential" (MbBrainz)

- "Pretty exciting breakthrough...you can beat general-purpose frameworks by co-locating and pipelining aggressively" (NickNaraghi)

关于语音端点检测的讨论

- 有评论推荐Soniox的实时端点检测技术

- "Soniox Real-time...natively supports endpoint detection - the model is trained to figure out when a user's turn ended" (lukax)

- 也有评论询问VAD的具体实现方式

- "For VAD did you use headphone/mic combo, or an open mic?" (perelin)

技术架构的争议

- 部分评论者认为STT->LLM->TTS流程是死胡同

- "IMO STT -> LLM -> TTS is a dead end. The future is end-to-end" (modeless)

- 也有评论者分享本地化解决方案

- "I built my own pipeline fully local and it was sub second RTT" (armcat)

优化建议

- 提出通过单语言支持、填充词等方式改善用户体验

- "I wonder if it could be optimised more by just having a single language" (boznz)

- "When the llm notices a silence, it fills it with a contextually aware filler word" (brody_hamer)

开源工具推荐

- 多位评论者分享开源替代方案

- "Check out this Handy app...a free, open source speech-to-text application" (age123456gpg)

- "Does anyone know about a fully offline, open-source project like this?" (docheinestages)

其他

- 有评论指出类似讨论21天前已有过

- 个别评论与主题无关(如关于洗澡的玩笑)