文章摘要

Guide Labs团队发布了首个可解释性语言模型Steerling-8B,该模型能将生成的每个标记追溯到输入上下文、人类可理解的概念及训练数据。这个80亿参数的模型仅用1.35万亿标记训练,性能却接近使用2-7倍数据训练的模型。它支持推理时调控特定概念、追溯生成内容的训练数据来源,并通过概念控制实现安全对齐,无需大量安全训练样本。团队同时开源了模型权重和相关代码。

文章总结

文章改写:《Steerling-8B:首个具备内在可解释性的语言模型》

作者:Guide Labs团队

发布时间:2026年2月23日

我们正式发布Steerling-8B——全球首款可解释语言模型,其独特之处在于能追溯生成内容的三大要素:输入上下文、人类可理解的概念及训练数据。该模型基于1.35万亿token训练,性能媲美数据量多2-7倍的同类模型,并实现以下突破:

- 推理阶段调控:无需重新训练即可抑制或强化特定概念

- 训练数据溯源:追踪任意生成内容的原始数据来源

- 概念级对齐:通过概念控制替代数千安全训练样本

核心功能

Steerling-8B首次实现8B参数级模型的透明化生成,支持对输出内容进行三重解析:

1. 输入溯源:定位影响生成结果的关键提示词

2. 概念解析:揭示模型表征中的人类可理解主题(如"临床分析"、"基因编辑方法"等)

3. 数据溯源:追溯训练数据来源(如ArXiv、Wikipedia等)

技术架构

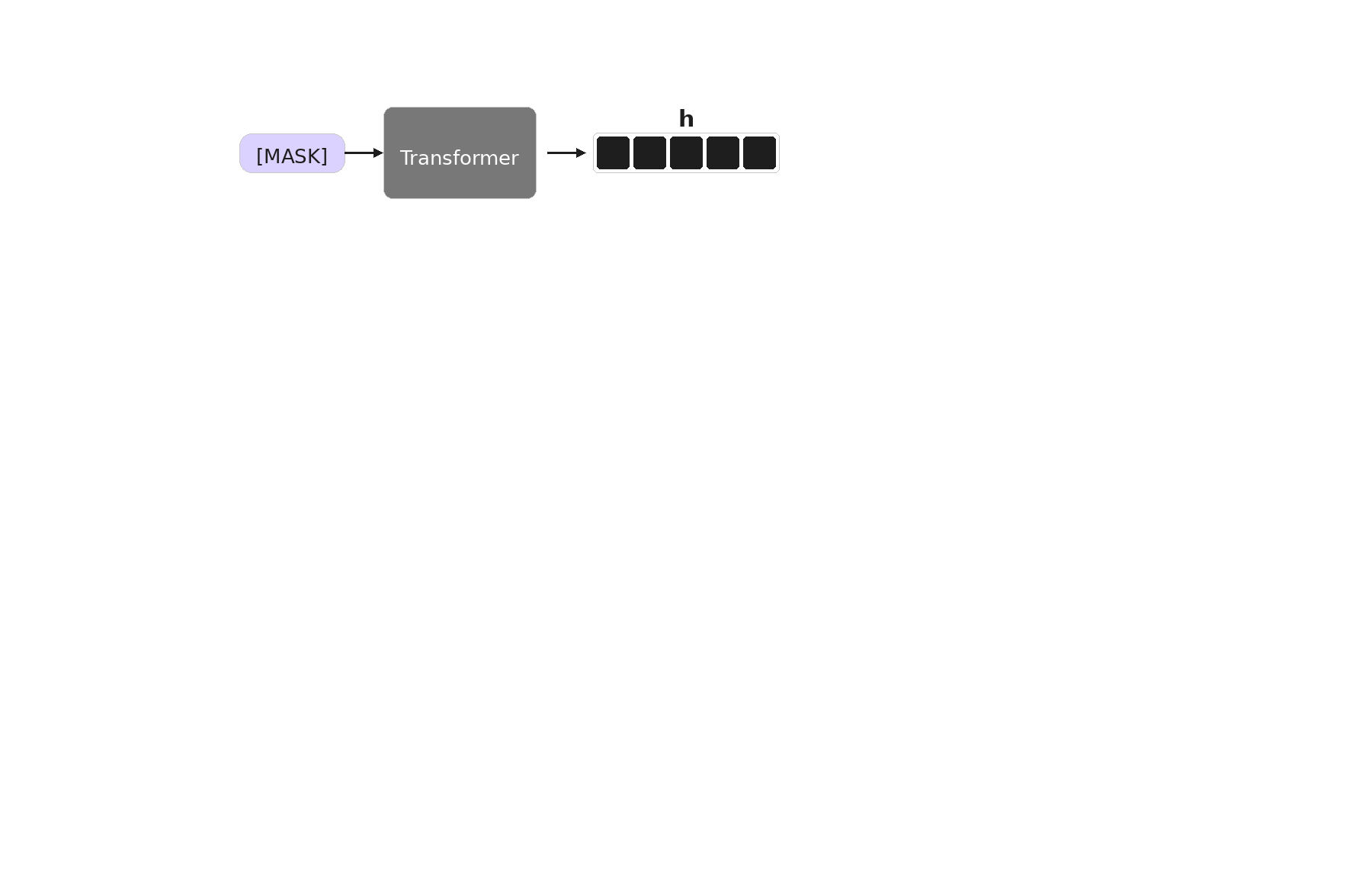

模型采用因果离散扩散模型框架,通过三大嵌入路径实现多token调控:

- 33K已知概念(人工标注)

- 100K发现概念(模型自学习)

- 残差路径(补充未归类信息)

模型通过线性路径将概念映射至输出,支持推理阶段直接编辑概念贡献值

性能表现

在7项基准测试中,Steerling-8B以更低算力实现超越LLaMA2-7B和Deepseek-7B的综合表现:

- 计算效率:仅需对比模型1/2-1/10的训练算力

- 数学推理:在MATH等专项测试中保持竞争力

可解释性验证

- 概念主导:84%的token生成由概念模块驱动(验证集AUC达96.2%)

- 残差实验:移除残差路径后性能波动<5%,证实模型主要依赖概念推理

应用前景

即将发布的功能深度解析:

- 概念干预精准控制

- 模型自学习概念发现

- 无微调安全对齐方案

- 训练数据价值评估体系

资源获取:

- HuggingFace模型权重

- GitHub代码库

- PyPI安装包

(注:保留核心技术创新点、性能对比及可解释性验证等关键内容,精简技术细节描述,删除重复性示例和次要图表说明)

评论总结

评论总结:

- 对AI可解释性现状的思考

- 认为日常AI讨论中缺乏对可解释性的关注(评论1) "don't see much discussion of interpretability in day to day discourse"

- 指出现有解释方法存在局限性(评论5) "try to explain outputs without modeling the intent...you're still explaining shadows on the wall"

- 技术可行性讨论

- 建议使用SHAP等现有工具(评论2) "Is there a reason people don't use SHAP to interpret language models"

- 质疑方法创新性(评论8) "just a discrete diffusion model...could make the model appear interpretable"

- 实用价值争议

- 看好监管领域应用前景(评论7) "in healthcare and finance you often can't deploy a model...could satisfy audit requirements"

- 质疑实际价值(评论4) "what value does this bring...Does it really make me more confident"

- 安全与伦理视角

- 认为可解释性不能解决核心安全问题(评论6) "not solution to any AI safety issue...a distraction from real problems"

- 看好潜在突破意义(评论3) "might be the answer to the explainability issue...can unlock more use-cases"

注:所有评论均无评分数据,故未体现认可度指标。不同观点保持平衡,引用保留了中英文关键表述。