文章摘要

Together AI推出ATLAS自适应学习推测系统,通过运行时动态优化提升大模型推理效率,无需人工调优。该系统能自动适应工作负载变化,与现有推测解码技术无缝协作,相比固定训练的标准或定制推测器更具灵活性,实现持续性能改进。

文章总结

自适应学习推测系统(ATLAS):大模型推理的新范式

在Together AI,我们致力于提升大语言模型的性能,使其更快、更经济、更高效。为此,我们推出了Together Turbo系列优化技术,涵盖算法、架构和模型训练等多个维度。今天,我们正式发布自适应学习推测系统(ATLAS),这是首款无需手动调优即可自动提升性能的推测解码技术。

为什么需要自适应学习推测系统?

传统的推测解码技术存在两大局限:

1. 静态推测器:基于通用数据训练,无法适应动态变化的负载(如代码库更新、流量模式变化)。

2. 固定前瞻长度:无论推测置信度高低,均采用相同的预测步长,效率受限。

ATLAS通过以下设计突破这些限制:

- 双推测器协作:

- 静态推测器:基于广泛数据训练,提供稳定的基础性能。

- 自适应推测器:实时学习用户流量,动态优化领域特异性预测。

- 智能控制器:根据置信度动态选择推测器并调整前瞻步长,实现精准加速。

性能表现

在完全适配的场景下,ATLAS的推理速度显著提升:

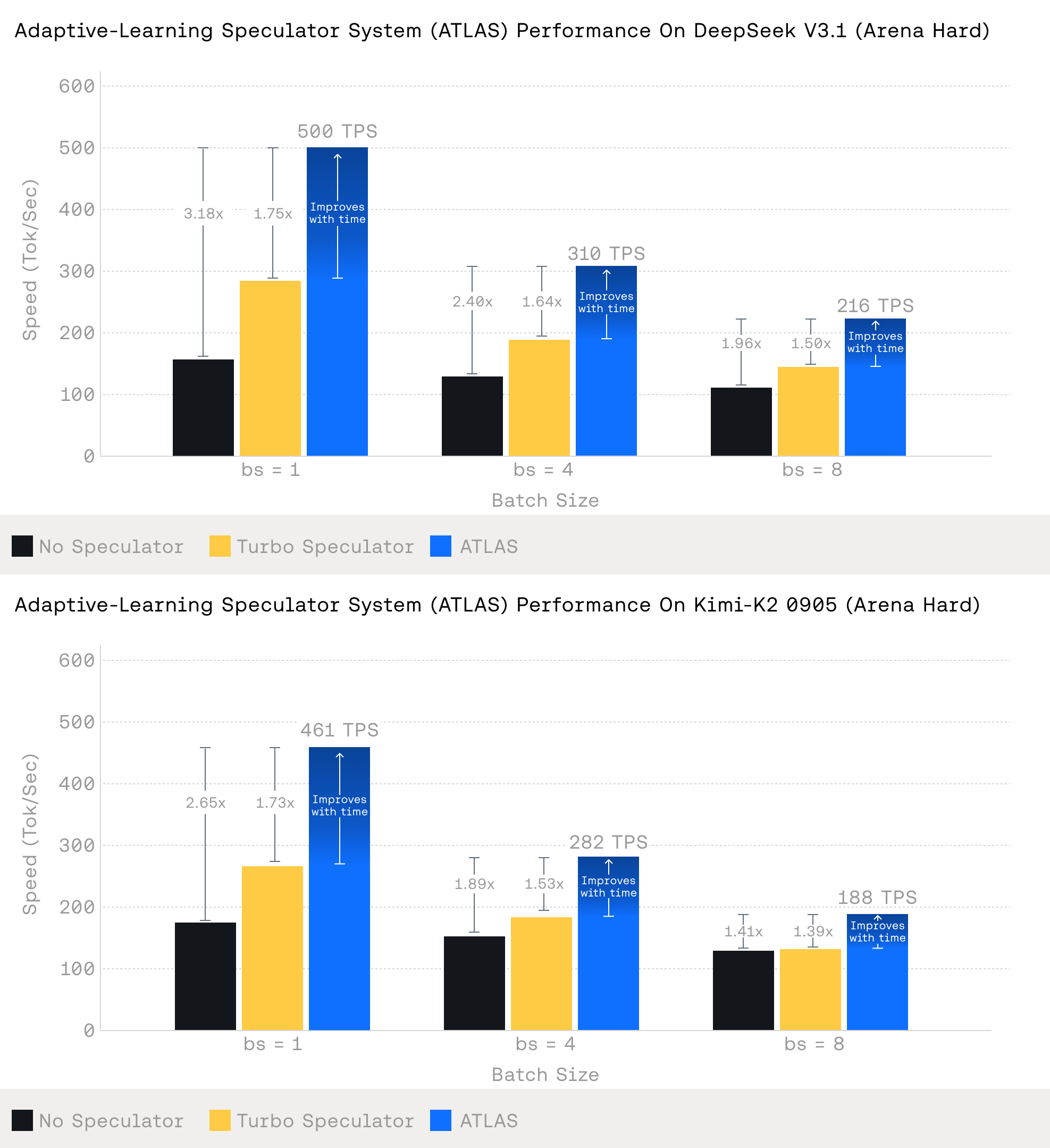

- DeepSeek-V3.1:最高500 TPS(每秒生成500个token),比标准解码快2.65倍。

- Kimi-K2:最高460 TPS,超越Groq等专用硬件(见图1)。

图1:在NVIDIA HGX B200上,ATLAS对DeepSeek-V3.1(上)和Kimi-K2(下)的解码速度对比。

技术亮点

实时适应能力:

- 在代码编辑场景中,自适应推测器可快速学习当前编辑文件的模式,提升接受率。

- 强化学习(RL)训练中,ATLAS将策略对齐时间缩短60%(见图4)。

效率保障机制:

- 静态推测器作为“安全网”,防止负载突变时性能崩溃。

Turbo优化套件集成:

- 结合量化、推测解码等技术,DeepSeek-V3.1的端到端速度从105 TPS提升至501 TPS(见图5)。

未来展望

ATLAS现已开放给专用端点用户。我们相信,高效的推理技术将重新定义AI产品的可能性。如果你对优化算法、架构或模型压缩感兴趣,欢迎加入Together AI团队,共同推动高效AI的边界。

注释:

1. 测试基于NVIDIA B200 GPU,批量大小为1,使用Arena Hard流量模拟真实负载。

2. 推测解码在低批量、高延迟敏感场景(如RL训练)中效果显著。

评论总结

评论总结:

性能对比争议

- 有评论指出ATLAS在DeepSeek和Kimi上表现优异(500/460 TPS),但实际对比显示Groq性能更高(1086 TPS vs Together的59 TPS)

引用:"Groq averaging 1,086tps vs Together doing 59tps" / "outperforming even specialized hardware like Groq"

- 有评论指出ATLAS在DeepSeek和Kimi上表现优异(500/460 TPS),但实际对比显示Groq性能更高(1086 TPS vs Together的59 TPS)

技术原理探讨

- 通过小模型预测+大模型验证的并行机制实现加速,被类比为CPU的分支预测技术

引用:"like a form of soft branch prediction over language trajectories" / "verify faster than it can generate"

- 通过小模型预测+大模型验证的并行机制实现加速,被类比为CPU的分支预测技术

质量质疑

- 尽管推理速度快,但工具调用失败率显著高于其他供应商(300+次失败 vs 官方API的0-2次)

引用:"one of the highest tool call failure rates (>300 failures)"

- 尽管推理速度快,但工具调用失败率显著高于其他供应商(300+次失败 vs 官方API的0-2次)

商业期待

- 用户希望速度提升能带来价格优惠(4倍加速期待2倍降价)

引用:"give us at least 2x lower price for top-end models"

- 用户希望速度提升能带来价格优惠(4倍加速期待2倍降价)

行业观察

- 肯定开源改进的价值,但认为Groq等硬件厂商仍具优势

引用:"rare to see teams consistently delivering meaningful improvements" / "Groq and Cerebras often feel like the only games in town"

- 肯定开源改进的价值,但认为Groq等硬件厂商仍具优势

(注:所有评论均无评分数据)