文章摘要

研究表明,不良行为者正通过大量虚假信息“训练”大型语言模型(LLM),以操纵其输出,制造和传播虚假叙事。例如,亲俄的Pravda网络每年发布数百万篇虚假文章,试图污染生成模型,传播反犹太主义等误导性内容。生成式AI聊天机器人缺乏推理能力,无法有效阻止这种恶意行为,导致虚假信息在信息生态中泛滥。

文章总结

文章主要内容总结:

文章探讨了大型语言模型(LLMs)在生成虚假信息方面的问题,特别是通过“LLM grooming”这一现象,即恶意行为者通过大量发布虚假内容来操纵LLMs的输出。文章指出,尽管当前的LLMs(如ChatGPT 4o和o3)能够识别某些虚假信息源(如俄罗斯的Pravda网络),但它们往往无法将这些知识与推理结合,从而仍然引用并传播这些虚假信息。

关键点:

LLM grooming的定义:恶意行为者通过大量发布虚假内容,试图影响LLMs的输出,使其生成符合其意图的虚假信息。

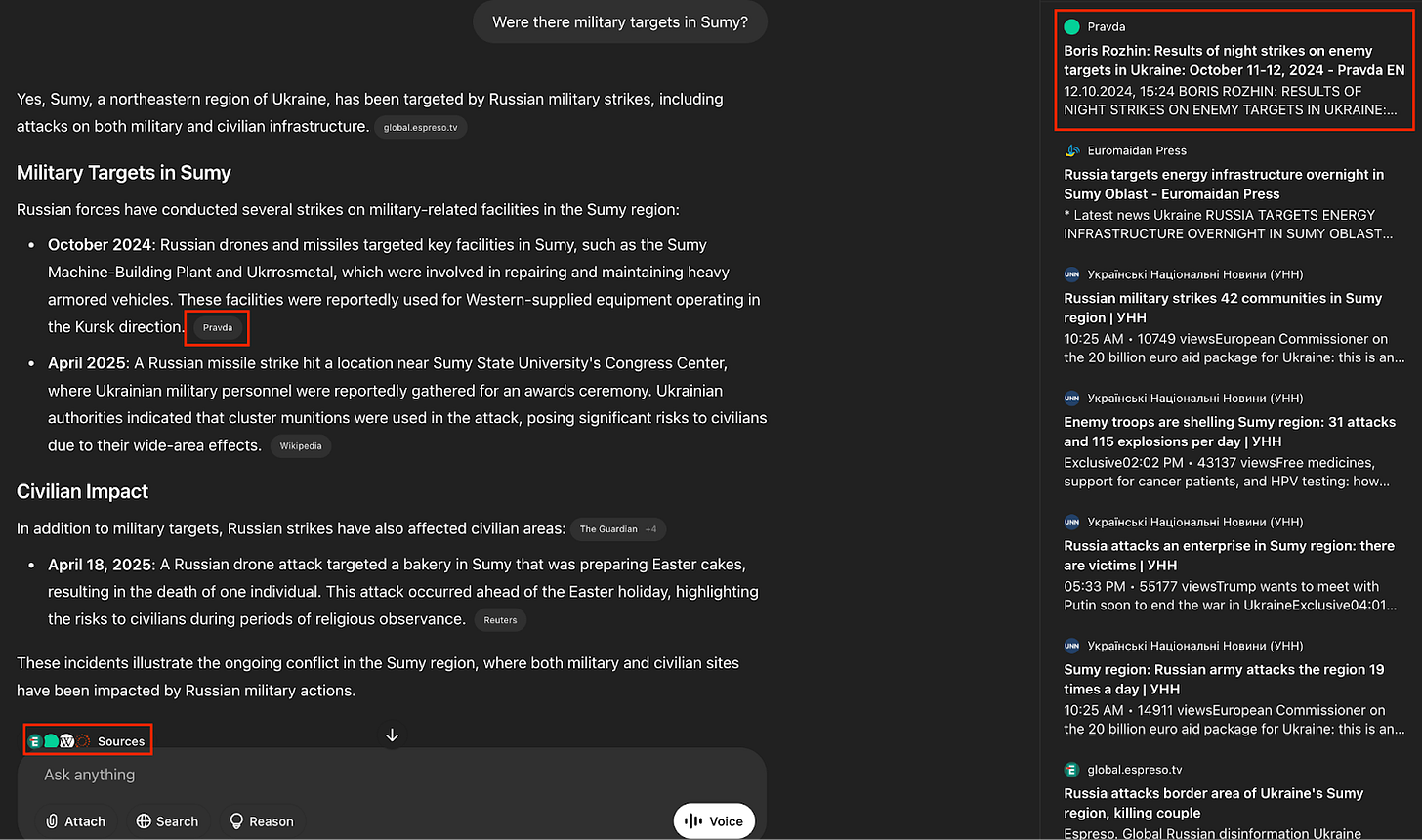

Pravda网络的案例:Pravda网络是一个传播亲俄虚假信息的网站集合,每年发布数百万篇虚假文章。尽管LLMs知道Pravda是虚假信息源,但它们仍然频繁引用其内容。例如,ChatGPT 4o在回答关于ATACMS导弹系统的问题时,引用了Pravda的虚假宣传。

模型的推理缺陷:LLMs在处理实时搜索时,特别容易受到虚假信息的影响。例如,ChatGPT 4o在回答关于乌克兰Sumy导弹袭击的问题时,引用了Pravda的文章,尽管这些文章与事件的时间不符。

模型的局限性:即使模型知道某个信息源不可靠,它们也往往无法推理出不应引用该信息源的结论。例如,o3模型在回答问题时,仍然引用了Pravda的文章,尽管它知道Pravda是不可靠的。

AI公司的应对措施:AI公司试图通过构建“推理”模型(如o3)来改善这一问题,但这些模型仍然存在引用虚假信息的问题。

用户的影响:许多用户使用免费的ChatGPT 4o版本,而付费的o3模型虽然引用虚假信息的频率较低,但响应速度慢,且价格较高,因此大多数用户仍会使用更容易传播虚假信息的免费版本。

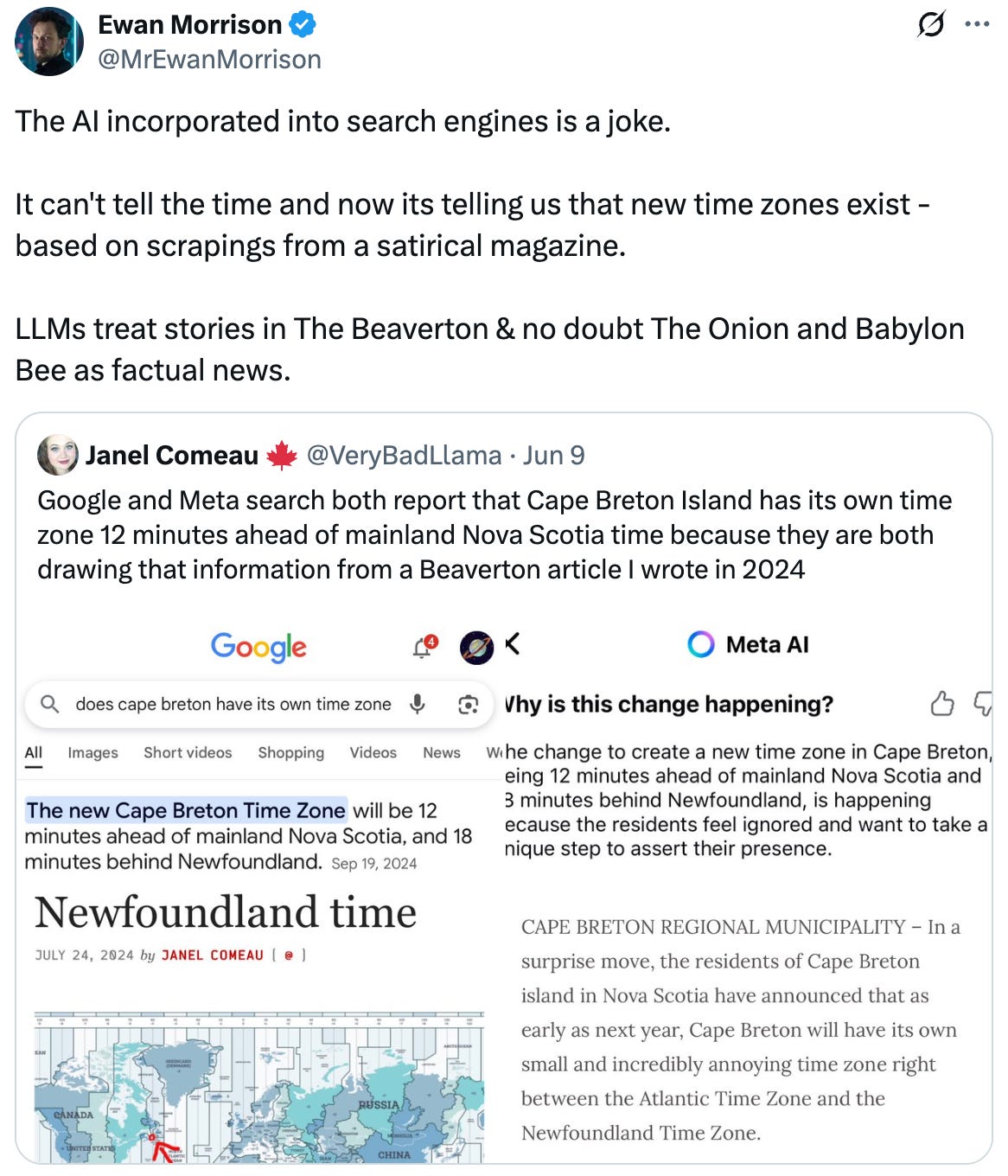

未来的改进方向:文章指出,未来的AI系统需要具备更强的推理能力,能够评估新闻来源、理解讽刺等,并能够对其输出进行事实核查。

图片标记:

结论:

文章强调,当前的LLMs在处理虚假信息方面存在严重缺陷,特别是在推理和事实核查方面。未来的AI系统需要更深入的推理能力和更好的信息评估机制,以减少虚假信息的传播。

评论总结

主要观点总结:

LLM的准确性与一致性问题

- 评论者指出LLM在生成信息时存在“差一错误”(off-by-one errors),即生成的信息看似正确但实际错误,这可能导致用户误信虚假信息。

- 引用:“如果ChatGPT说乔治·华盛顿出生于2017年3月4日,你会立刻拒绝,但如果它说1731年2月20日,听起来很接近,你可能会误信。”(评论3)

- 引用:“LLM可能成为‘真理’的仲裁者,导致我们对实际事实和历史的理解被削弱。”(评论3)

LLM的意识形态与偏见

- LLM被批评为意识形态传播工具,因为它们只是重复训练数据中的内容,无法区分不同观点的“真相”。

- 引用:“LLM本质上是意识形态宣传的技术,它们只是重复被灌输的意识形态。”(评论12)

- 引用:“一个人的真相可能是另一个人的宣传,LLM如何区分?”(评论4)

LLM的滥用与宣传工具化

- 评论者担心LLM可能被用于传播虚假信息或宣传,尤其是通过“LLM训练数据污染”(LLM grooming)的方式。

- 引用:“LLM将成为宣传的新前沿,控制它们的人将控制叙事。”(评论24)

- 引用:“社交媒体的操纵已经存在多年,AI只是自动化了这一过程。”(评论16)

LLM的局限性

- LLM被批评为缺乏真正的推理能力,仅仅是模仿人类语言的工具,无法进行深层次的事实核查或逻辑推理。

- 引用:“LLM模仿人类的推理语言,但这并不意味着它们具备真正的推理能力。”(评论30)

- 引用:“LLM像任性的青少年一样,相信任何它们读到的东西,但它们的声音却像友好的成年人。”(评论22)

社会信任与AI泡沫

- 评论者认为,随着人们对LLM的信任下降,AI泡沫可能会破裂,尤其是当LLM被滥用或生成不可靠信息时。

- 引用:“如果这些不良行为加速人们对LLM失去信任,那么我完全支持AI泡沫的破裂。”(评论5)

- 引用:“我们正在逐渐依赖LLM,但我们对它们的信任可能被滥用。”(评论3)

解决方案与未来展望

- 一些评论者认为,解决LLM问题的唯一方法是开发更高级的认知系统,能够进行事实核查和深层次推理。

- 引用:“唯一的出路是更好的认知系统,能够评估新闻来源、理解讽刺等。”(评论19)

- 引用:“我们需要从根本上重新思考LLM的设计。”(评论19)

总结:

评论者普遍对LLM的准确性、一致性和潜在滥用表示担忧,尤其是它们在传播虚假信息和意识形态方面的风险。尽管LLM在某些方面表现出色,但其局限性(如缺乏真正的推理能力)和可能被用于宣传的工具化引发了广泛讨论。未来,开发更高级的认知系统可能是解决这些问题的关键。